联泰集群 AI 模型算法研发与加速平台 LtAI——域管理员使用手册

联泰集群 AI 模型算法研发与加速平台

LtAI

域管理员使用手册

联泰集群(北京)科技有限责任公司

2025年12月

目录

1. 概述

本文为联泰集群AI模型算法研发与加速平台(简称LtAI)的域管理员相关的管理功能使用方法进行说明。

读者对象为域管理员。

2. 平台管理相关术语说明

本节对LtAI平台涉及的术语、缩略语进行说明。理解这些术语、缩略语在平台使用和资源管理过程中至关重要。

2.1. 计算资源和存储资源

在智算、科学计算中所使用的计算机资源,一般包括计算资源、存储资源和网络资源。其中计算资源主要是运行计算任务所需要的算力,一般包括CPU核、GPU卡、内存。存储资源一般是指各种持久化存储空间,用于存储用户数据、模型、日志数据、结果数据、快照数据等,常见的有服务器本地硬盘存储空间、分布式网络存储空间。网络资源主要是指计算过程中进行节点间通信所需要的网络带宽、以及上传下载数据所需要的网络带宽等。

在LtAI中,将网络资源纳入了计算资源中进行统一配置和管理,统称为“计算资源”;而“存储资源”主要是指在集群中能够统一管理和分配的分布式网络存储空间。

LtAI的算力调度功能,主要实现是对计算资源和存储资源的配置、管理和调度。

2.2. 容器

本平台的容器管理体系基于Kubernetes(K8s)构建。容器(Container)是应用运行的基本单元,它提供了一种轻量级、可移植且隔离的运行环境。容器封装了应用程序及其依赖(如代码、运行时、系统工具、库等),确保应用在不同环境、不同节点、不同硬件上一致运行。容器具有以下特点。

1) 轻量高效

o 与传统虚拟机(VM)不同,容器共享宿主机的操作系统内核,无需单独启动操作系统,因此启动更快、资源占用更低。

o 适合微服务架构,支持高密度部署和快速弹性扩缩容。

2) 环境一致性

o 容器镜像(Image)采用分层存储(Layer)机制,确保开发、测试、生产环境的一致性,避免“在我机器上能跑”的问题。

3) 进程级隔离

o 通过Linux Namespace和Cgroups机制实现进程、网络、文件系统等资源的隔离,保障应用互不干扰。

4) 动态生命周期

o 在K8S中,容器通常由Pod管理,可能因调度、故障或滚动更新被重建,因此容器本身是无状态的,数据默认不持久化(持久化存储数据需依赖容器挂载的外部存储)。

请特别注意:在容器云平台中,容器本身是轻量级、临时性的运行环境,其文件系统默认采用非持久化存储。这意味着:

‒ 容器内数据的非持久性

容器运行时产生的数据(如日志、临时文件或应用运行时数据)默认仅存在于容器生命周期内。当容器停止、重启或删除时,这些数据将随之丢失。此设计符合容器的不可变基础设施(Immutable Infrastructure)原则,即容器应被视为一次性实体,而非长期存储数据的载体。

‒ 持久化存储的必要性

如需长期保留数据(如数据库文件、配置文件或用户上传内容),必须将数据存储在容器外部的持久化存储中。平台支持通过挂载外部存储卷或绑定宿主机目录实现数据持久化。

‒ 操作建议

o 避免将重要数据直接写入容器内部文件系统。

o 在部署时显式声明存储卷挂载,确保数据路径指向外部存储。

o 定期备份持久化存储中的数据,即使采用外部存储仍需防范意外删除或损坏。

通过合理规划存储策略,可兼顾容器的敏捷性与数据的可靠性。

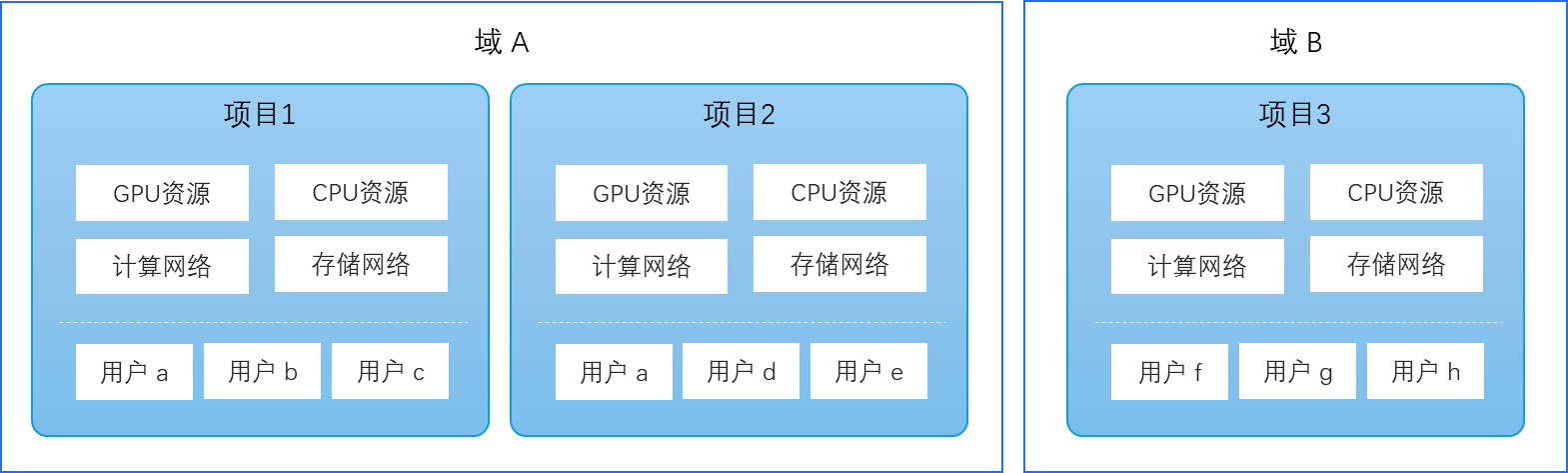

2.3. 域

域是平台中最高层级逻辑单元,代表一个相对独立的资源空间或组织边界。一般可以将一个单位、一个部门、一个院系或一个课题组定义为一个域,其中包含若干用户、若干项目和若干资源。

域中可配置一个或多个域管理员,对域中的项目、用户和资源进行管理。与、项目、用户和资源的关系参见图 1。

1. 用户管理

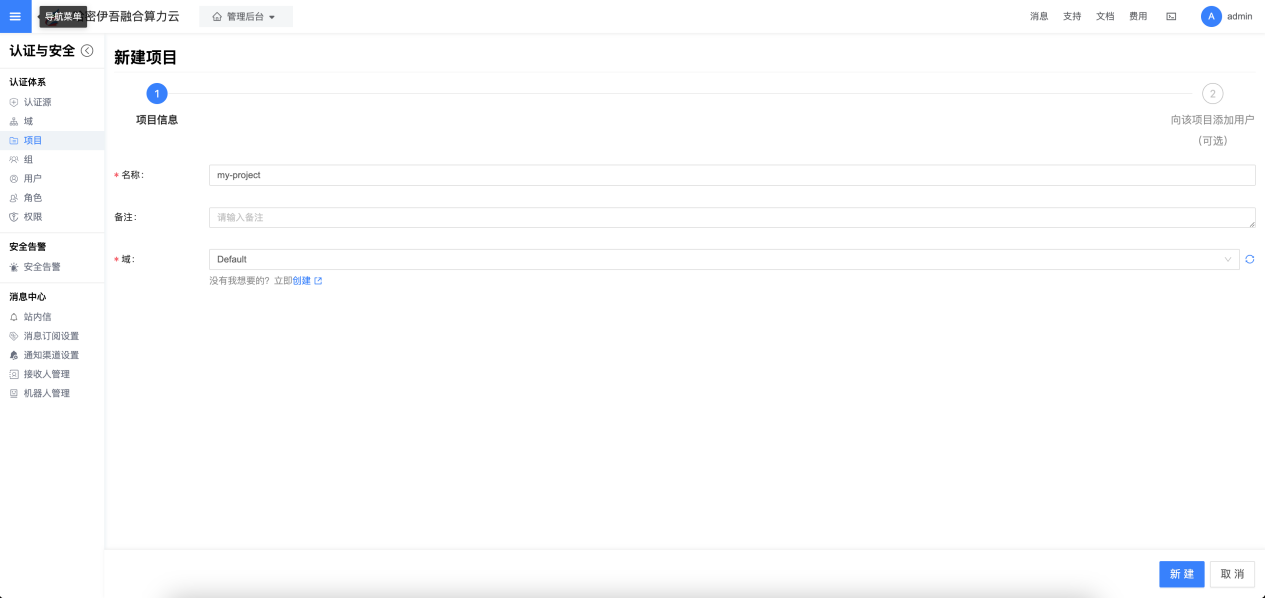

域管理员可以管理域内的项目、用户、用户组及对应的角色、权限。

通过全局导航「认证与安全」-「项目」进入项目管理页面,点击菜单栏「新建」按钮,在弹出的表单中填写相关信息完成项目的创建及项目用户的添加。

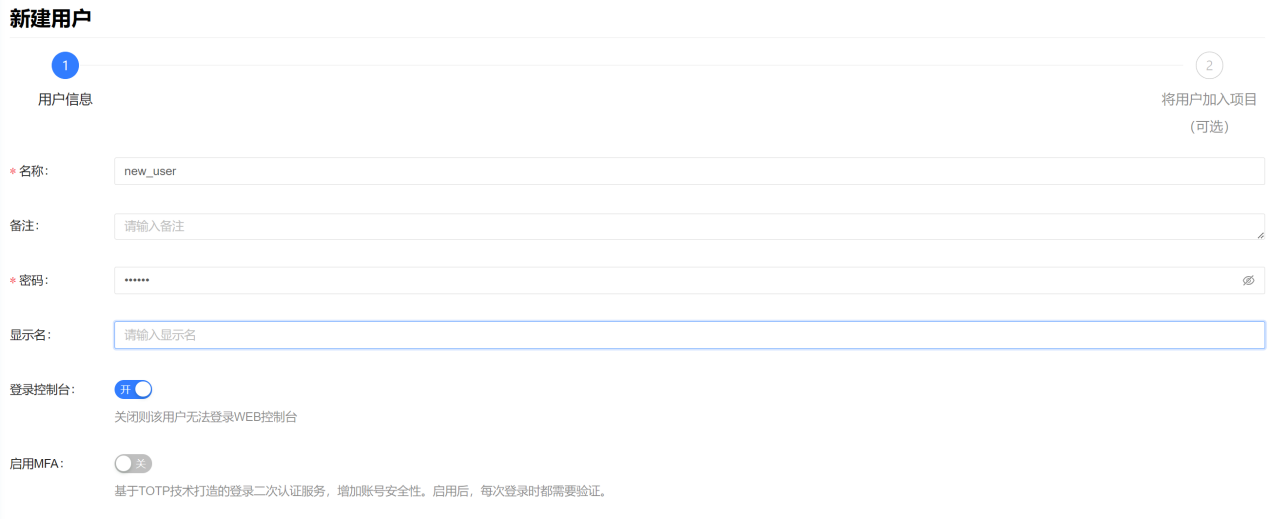

通过全局导航「认证与安全」-「用户」进入用户管理页面,点击菜单栏「新建」按钮,可创建用户。

创建用户后,第二步可以跳过。

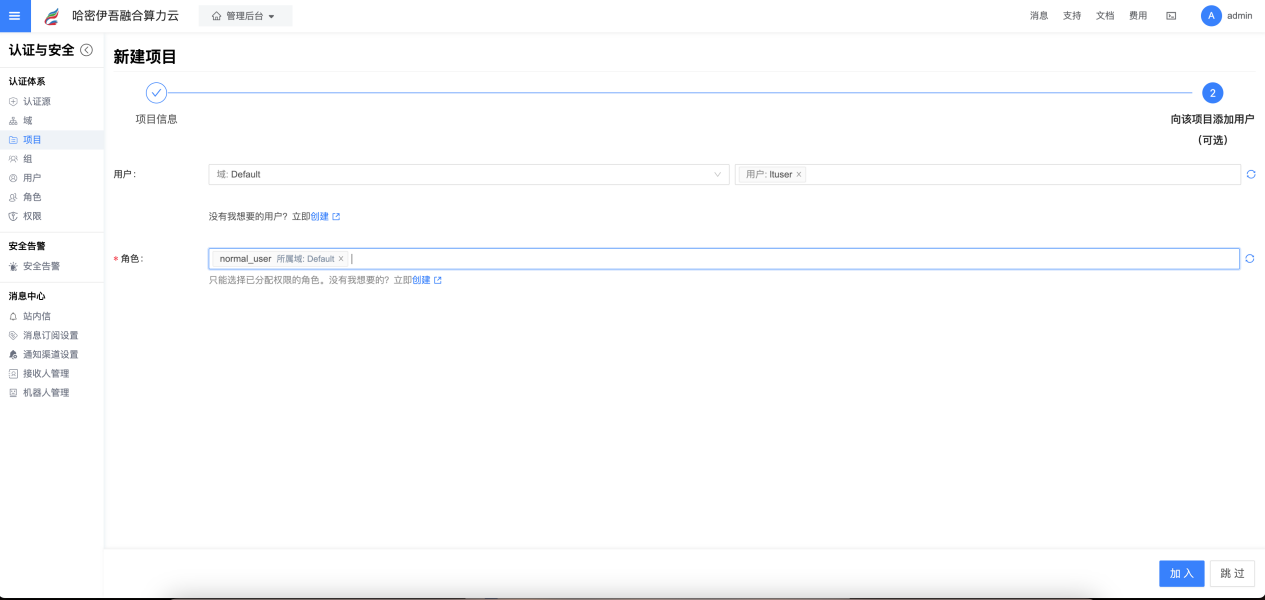

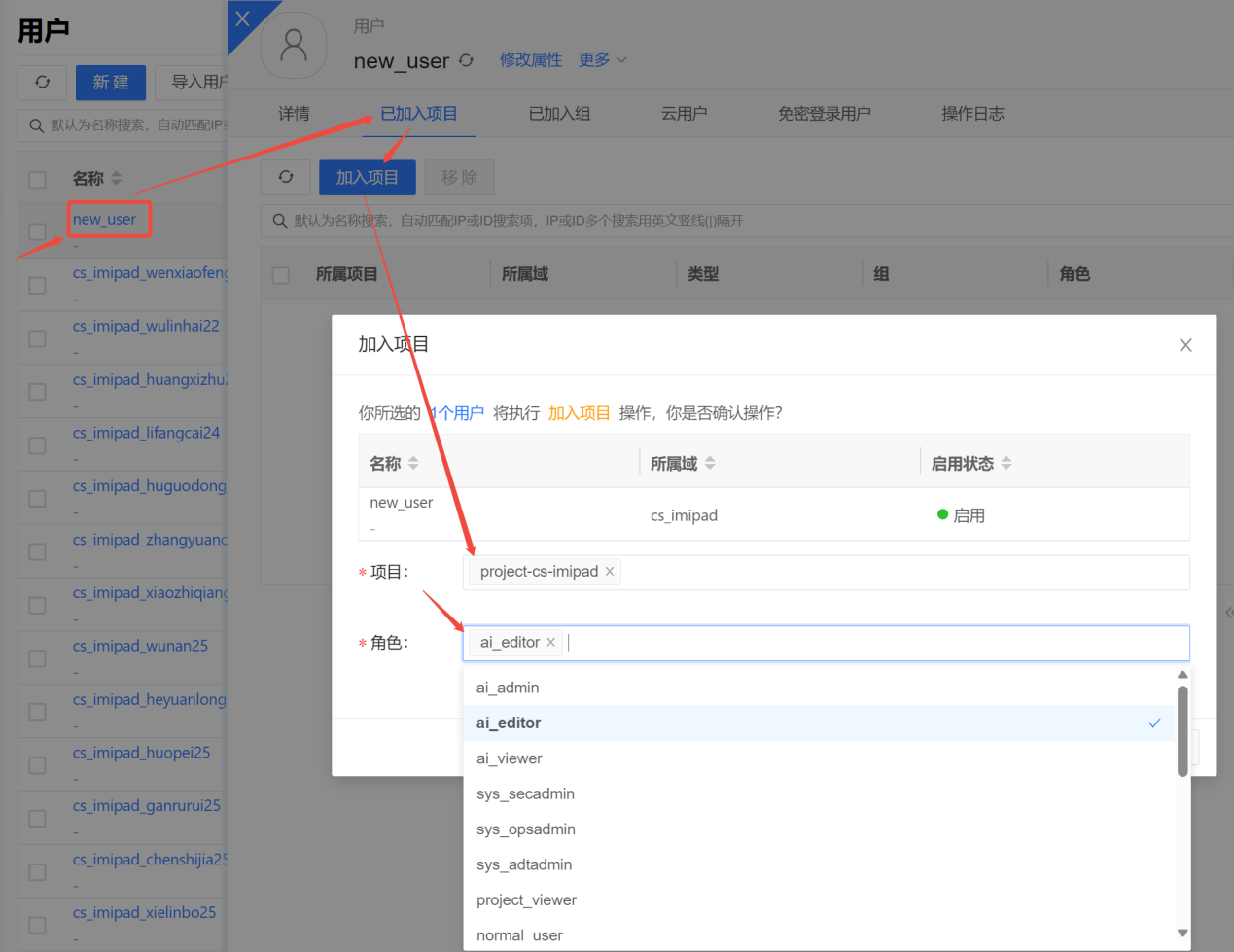

在用户列表中,点击用户,可以将用户加入项目并配置权限,如下图所示。

图2 将用户加入项目并配置其角色

普通用户的角色配置为“ai_editor”一个即可。

域管理员的角色配置为“ai_admin”、“domainadmin”、“project_owner”三个。

1. 专属资源配置和管理

域管理员主要涉及的资源配置是对“专属资源”的配置和管理。

专属资源是指将平台纳管特定一个或多个节点,分配给域,由域管理员进行管理和配置,并只能由该域内的用户使用的资源。

专属资源由域管理员全权管理和控制。域管理员可以针对专属资源配置所需的算力规格、资源队里,供域内用户使用。

1.1. 申请专属节点

申请专属资源,前提是平台管理员创建好节点规格,并将拟分配给各域的专属资源节点标记上相应的节点规格。

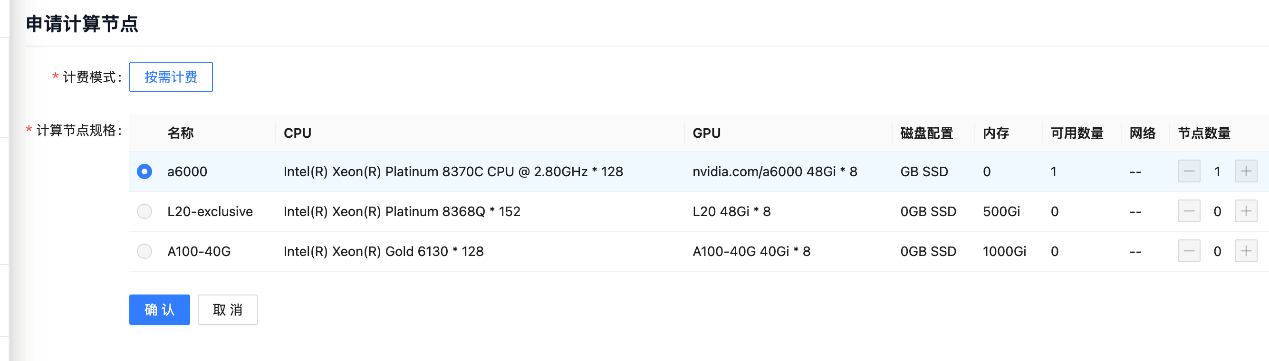

在平台管理员完成了上述操作后,域管理员可以在 [机器学习 – 专属资源] 菜单项(如图 3所示)进入专属资源管理页面,点击 [申请计算节点](如图 4所示)。

在申请页面,域管理员可以看到被管理员设置为专属资源的节点类型及数量,可以在该页面申请对应的专属资源(图 5)。

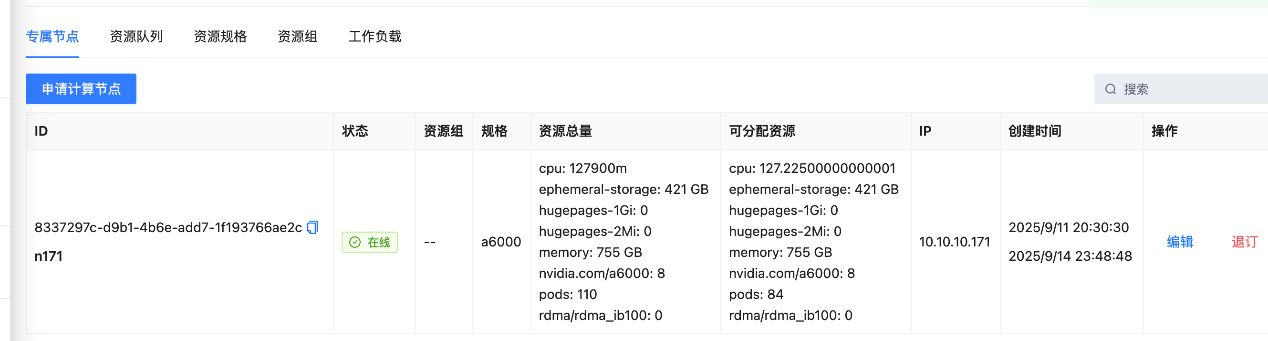

点击 [确认]后,对应的资源就会被设置为该域下的专属资源(图 6)。

在申请到的专属节点列表中,可以看到节点的主要信息,包括节点ID、节点名称、节点状态(在线/离线)、所属资源组、资源总量、可分配资源、节点IP地址等。

其中“资源总量”一列可以看到节点所包含的主要资源数量,主要关注如下字段:

‒ cpu(CPU核数):以微核(千分之一个CPU核,即将每个CPU核的计算能力划分为1000份)为单位,如图 6中数据表示有127900微核,即127.9个核;

‒ memory(内存):如图 6中数据表示有755GB内存;

‒ 显卡类型和卡数:如图 6中数据表示显卡类型为 nvidia.com/a6000,卡数为8;

‒ RDMA存储网络带宽:如图 6中数据表示RDMA存储网络为rdma/rdma_ib100,带宽为0(表示未启用),启用情况下该带宽值为1000,即将RDMA存储网络带宽分为1000份。

在“可分配资源”一列,显示了类似的数据,表示当前可用的资源数量,即除去已被占用的资源,剩余数量有多少。

1.1. 创建资源组

资源组可以看做是一个用于标记节点类型的标签,在算力调度时会根据资源组这个标签去查找标记该资源组的节点,并从这些节点上分配算力。

一般情况下一种类型的计算卡会设置同一名称的资源组来表示。

在专属资源页面,选择 [专属资源 – 资源组] 标签,点击 [创建资源组] 按钮(图 7),可创建一个新资源组(图 8)。

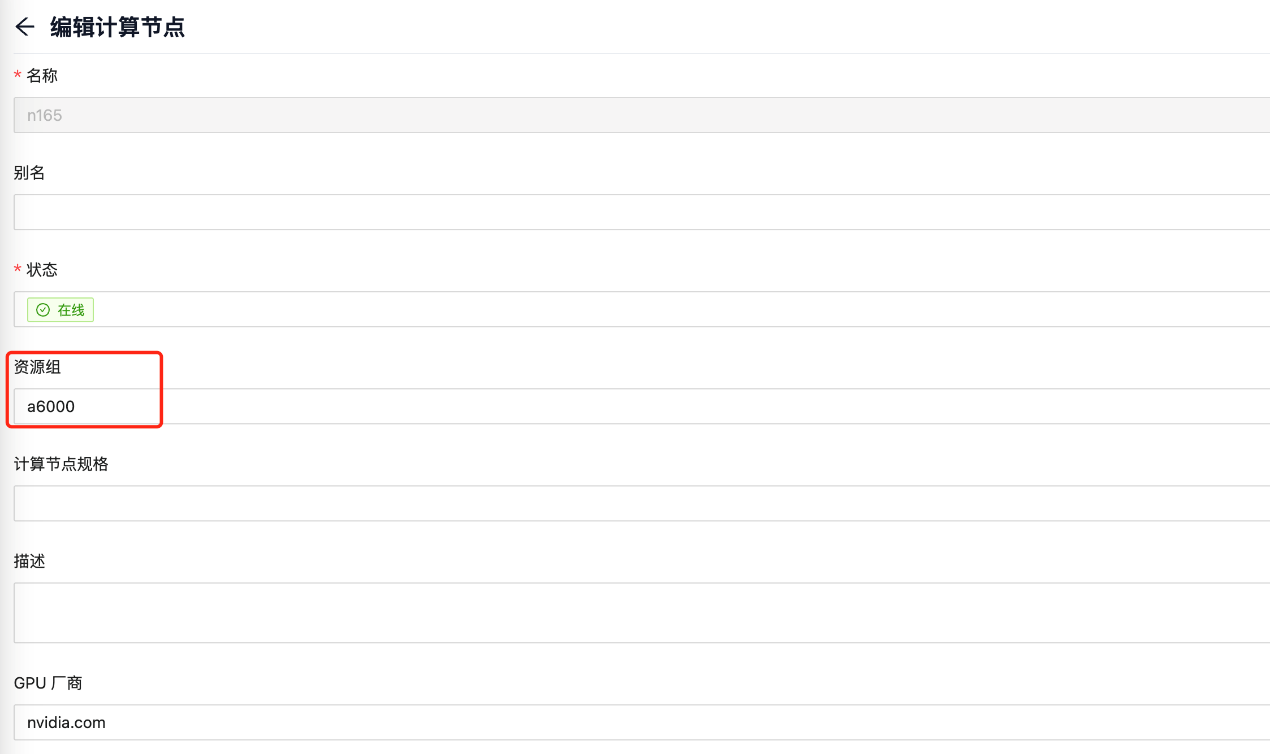

设置完成资源组后,还需要到[专属节点]标签页,点击“操作”列中的[编辑]按钮,将对应的资源节点加入到创建好的资源组。

图9 将节点加入资源组

4.3创建资源规格

资源规格的创建建议遵从1-2-4-8的配置,即1卡资源规格至8卡资源规格;对于CPU和内存,也建议遵从1-2-4-8等比例进行配置;同时,建议预留少量CPU和内存作为计算节点的基础设施资源。

例如计算节点一共有128个CPU,768G的内存,8张计算卡,在设置1卡资源规格时,可以设置1计算卡、15个CPU、90Gi内存;这样对应的8卡资源就是8计算卡、120个CPU、720Gi内存;预留了部分CPU和内存作为计算节点的基础设施资源。

在编辑资源规格时(图 1),GPU标识一般为nvidia.com/显卡名,或者参考节点的可分配资源名称;内存的单位是Gi;

GPU标识参考计算节点的资源描述,如所示。

图2 GPU标识

如果计算节点有ib网络,这部分的资源被虚拟化成了rdma/rdma_ib100,数量为1000;遵从1-2-4-8的原则,1卡的资源规格对应的rdma/rdma_ib100资源量就是1000/8=125,8卡的资源规格对应的rdma/rdma_ib100资源量就是1000。

图3 在“其它资源”中填写RDMA网络资源

4.4创建资源队列

在 [专属资源]页面的 [资源队列]标签页中点击 [创建队列]按钮(如图 4所示)可创建一个资源队列。

首先要给资源队列命名,一般可以以GPU数量和团队名称来命名,例如“A6000x8_IVIM”,表示给IVIM团队使用的包含8张A6000计算卡的一个资源队列。

资源队列的“权限”是指队列的可用范围,一般域管理员可配置为“团队共享”,这样在域下主项目内的用户都可以使用这个资源队列。这里如果设置为“个人私有”,则该队列只能由当前用户使用。

资源队列主要需要设置的参数为资源容量和资源规格;资源容量为该队列最大分配的资源数量,一般和计算卡数相关,例如设置为15卡的资源容量,对应的CPU、memory等资源就是15*单卡资源规格的数量;在下方同时关联资源规格的类型;如果一个队列的资源容量最大为4卡的计算资源,就可以设置最高为4卡的资源规格。

此外,在资源队列上还可以配置“主动资源回收策略”,该策略表示当某个使用该资源队列分配到资源的容器,其GPU使用率一直低于给定阈值达到给定时长后,容器将被自动关闭,释放掉其占用的资源。该策略默认“禁用”,即不会自动释放。如需开启,则就将其置为“启用”状态,并合理配置阈值和时长字段。

在资源队列编辑页面的下方设置“资源亲和”,选择之前创建的资源组名称并设置优先调度策略。这项配置实际就是让改资源队列中的资源请求(比如创建容器实例时)

图6 资源队列中选择调度到哪个资源组

点击 [确定]按钮后,该资源队列即可创建好。在资源列表中可以查看该资源队列的状态。

资源队列创建好后,域内用户即可使用该队列创建工作负载(即各类容器)。如下图所示。

图7 使用资源队列

5.资源查看

域内用户可以使用的资源分为两类:一类是由平台管理员给域内用户分配的公共资源池中的资源队列,另一类是由域管理员分配的专属资源的资源队列。

日常使用中,域管理员可以从[专属资源 –工作负载] 页面查看域内用户的资源负载和资源占用情况,如下图所示。

图1 域内资源占用情况查看

6多人共享容器操作

6.1创建用户

首先由域管理员创建用户,或使用现有用户,记录用户名。

用户名为cs_test_user、cs_test_user2、cs_test_user3、cs_test_user4。

6.2 创建容像

创建共享容器实例的容器镜像,在构建容器镜像时将所需用户名添加为容器镜像中的系统用户。

按需修改dockerfile文件,注意修改root用户的初始密码。

# 修改为适合自己的基础镜像 |

构建镜像:

dockerbuild . -t dev-share:v1

推送镜像(主要需要修改harbor库的路径,例如将harbor.gzu.atcloud.xyz/cs_test/改为harbor.gzu.atcloud.xyz/project/)

dockertag dev-share:v1 harbor.gzu.atcloud.xyz/cs_test/dev-share:v1

dockerpush harbor.gzu.atcloud.xyz/cs_test/dev-share:v1

注册镜像,不需要填写启动命令,若修改过Dockerfile,则按实际需求填写启动命令。

6.3 各用户创建磁盘存储

每个用户创建用于共享容器实例的存储空间,并以“dev-share-自己用户名”命名,权限设置为团队共享,大小按需要进行设置,取消勾选对他人只读。

其他用户同样方式创建磁盘存储。

6.4域管理员创建共享容器实例

挂载所有用户用于共享容器实例的磁盘,并修改挂载位置为对应的系统用户根目录,不需要填写启动命令。

初次使用时,需要域管理员切换到不同用户将ssh公钥填写到每位用户的根路径。

su cs_test_user |